Qui a WPBeginner abbiamo guidato milioni di utenti su come ottimizzare i loro siti web per la ricerca e aumentare il loro traffico organico. Abbiamo scoperto che un aspetto della SEO che i principianti spesso trascurano è il file robots.txt, che aiuta i motori di ricerca a scoprire, scansionare e indicizzare il vostro sito web.

Questo semplice file di testo agisce come un insieme di istruzioni, guidando i bot dei motori di ricerca su quali parti del vostro sito accedere e quali lasciare in pace.

Ottimizzando il file robots.txt, potete fare in modo che i motori di ricerca si concentrino sul crawling e sull’indicizzazione dei contenuti più importanti, evitando che sprechino risorse in aree meno importanti del vostro sito web.

Questo articolo vi mostrerà alcuni suggerimenti su come creare un file robots.txt perfettamente ottimizzato per il vostro sito WordPress, massimizzando il vostro potenziale SEO.

Che cos’è un file Robots.txt?

Robots.txt è un file di testo che i proprietari di siti web possono creare per indicare ai bot dei motori di ricerca come scansionare e indicizzare le pagine dei loro siti.

In genere viene memorizzato nella directory principale (nota anche come cartella principale) del sito web. Il formato di base di un file robots.txt è il seguente:

1 2 3 4 5 6 7 | User-agent: [user-agent name]Disallow: [URL string not to be crawled] User-agent: [user-agent name]Allow: [URL string to be crawled] Sitemap: [URL of your XML Sitemap] |

È possibile avere più righe di istruzioni per consentire o non consentire URL specifici e aggiungere più sitemap. Se non si disconosce un URL, i bot dei motori di ricerca presumono di poterlo scansionare.

Ecco come può apparire un file robots.txt di esempio:

1 2 3 4 5 6 | User-Agent: *Allow: /wp-content/uploads/Disallow: /wp-content/plugins/Disallow: /wp-admin/Sitemap: https://example.com/sitemap_index.xml |

Nell’esempio di robots.txt di cui sopra, abbiamo permesso ai motori di ricerca di scansionare e indicizzare i file nella cartella uploads di WordPress.

In seguito, abbiamo impedito ai bot di ricerca di effettuare il crawling e l’indicizzazione dei plugin e delle cartelle di amministrazione di WordPress.

Infine, abbiamo fornito l’URL della nostra sitemap XML.

Avete bisogno di un file Robots.txt per il vostro sito WordPress?

Se non si dispone di un file robots.txt, i motori di ricerca effettueranno comunque la scansione e l’indicizzazione del sito web. Tuttavia, non sarete in grado di dire loro quali pagine o cartelle non devono essere scansionate.

Questo non avrà molto impatto quando si apre un blog per la prima volta e non si hanno molti contenuti.

Tuttavia, quando il vostro sito web cresce e aggiungete più contenuti, è probabile che vogliate avere un controllo migliore sul modo in cui il vostro sito web viene carrellato e indicizzato.

Ecco perché.

I bot di ricerca hanno una quota di crawl per ogni sito web.

Ciò significa che il sistema esegue il crawling di un certo numero di pagine durante una sessione di crawling. Se esauriscono il budget di crawling prima di aver terminato la scansione di tutte le pagine del vostro sito, torneranno e riprenderanno la scansione nella sessione successiva.

Questo può rallentare il tasso di indicizzazione del vostro sito web.

È possibile risolvere questo problema impedendo ai bot di ricerca di tentare la scansione di pagine non necessarie, come le pagine di amministrazione di WordPress, i file dei plugin e la cartella dei temi.

Disabilitando le pagine non necessarie, si risparmia la quota di crawl. Questo aiuta i motori di ricerca a scansionare un numero ancora maggiore di pagine del vostro sito e a indicizzarle il più rapidamente possibile.

Un altro buon motivo per utilizzare un file robots.txt è quando si vuole impedire ai motori di ricerca di indicizzare un post o una pagina del proprio sito web.

Questo non è il modo più sicuro per nascondere i contenuti al pubblico, ma vi aiuterà a evitare che i contenuti appaiano nei risultati di ricerca.

Come si presenta un file Robots.txt ideale?

Molti blog popolari utilizzano un file robots.txt molto semplice. Il loro contenuto può variare a seconda delle esigenze del sito specifico:

1 2 3 4 5 | User-agent: *Disallow:Sitemap: https://www.example.com/post-sitemap.xmlSitemap: https://www.example.com/page-sitemap.xml |

Questo file robots.txt consente a tutti i bot di indicizzare tutti i contenuti e fornisce loro un link alle sitemap XML del sito web.

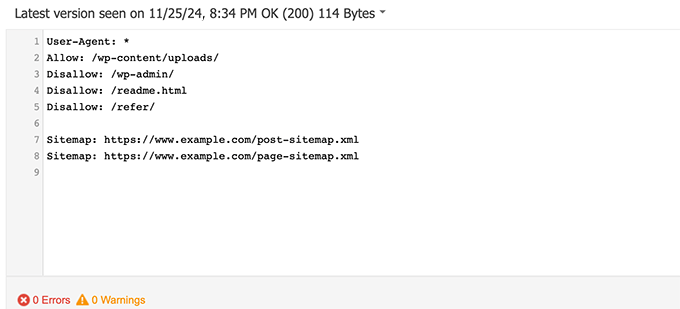

Per i siti WordPress, si consiglia di inserire le seguenti regole nel file robots.txt:

1 2 3 4 5 6 7 8 | User-Agent: *Allow: /wp-content/uploads/Disallow: /wp-admin/Disallow: /readme.htmlDisallow: /refer/Sitemap: https://www.example.com/post-sitemap.xmlSitemap: https://www.example.com/page-sitemap.xml |

Indica ai bot di ricerca di indicizzare tutte le immagini e i file di WordPress. Impedisce ai bot di ricerca di indicizzare l’area di amministrazione di WordPress, il file readme e i link affiliati occultati.

Aggiungendo le sitemap al file robots.txt, si facilita ai bot di Google l’individuazione di tutte le pagine del sito.

Ora che conoscete l’aspetto di un file robots.txt ideale, vediamo come creare un file robots.txt in WordPress.

Come creare un file Robots.txt in WordPress

Esistono due modi per creare un file robots.txt in WordPress. Potete scegliere il metodo che funziona meglio per voi.

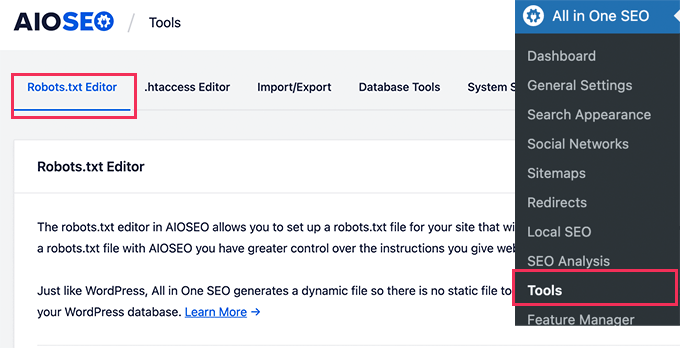

Metodo 1: Modifica del file Robots.txt con All in One SEO

All in One SEO, noto anche come AIOSEO, è il miglior plugin SEO per WordPress sul mercato, utilizzato da oltre 3 milioni di siti web. È facile da usare e viene fornito con un generatore di file robots.txt.

Per saperne di più, consultate la nostra recensione dettagliata di AIOSEO.

Se non avete ancora installato il plugin AIOSEO, potete consultare la nostra guida passo passo su come installare un plugin per WordPress.

Nota: è disponibile anche una versione gratuita di AIOSEO che dispone di questa funzione.

Una volta installato e attivato il plugin, è possibile utilizzarlo per creare e modificare il file robots.txt direttamente dall’area di amministrazione di WordPress.

Basta andare su All in One SEO ” Strumenti per modificare il file robots.txt.

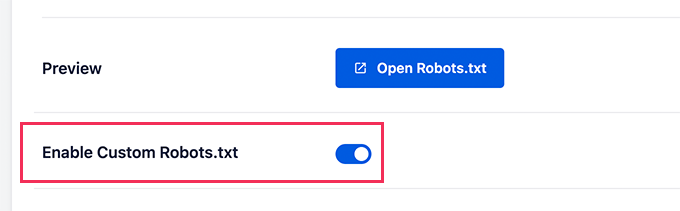

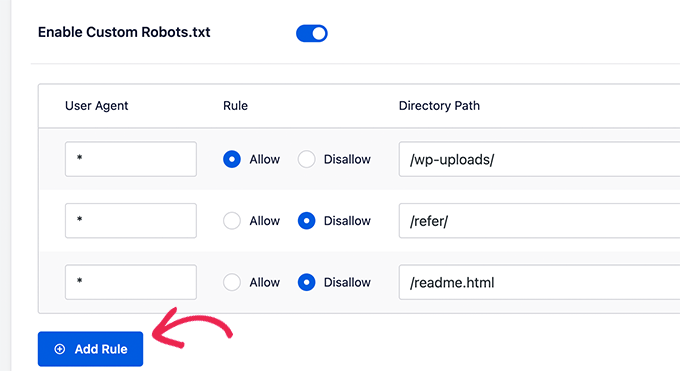

Per prima cosa, è necessario attivare l’opzione di modifica facendo clic sulla levetta blu “Enable Custom Robots.txt”.

Con questa opzione attivata, è possibile creare un file robots.txt personalizzato in WordPress.

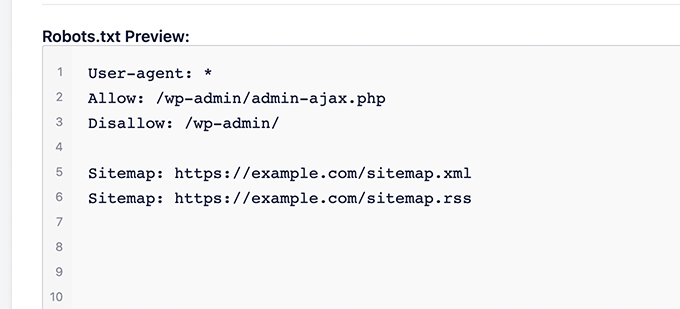

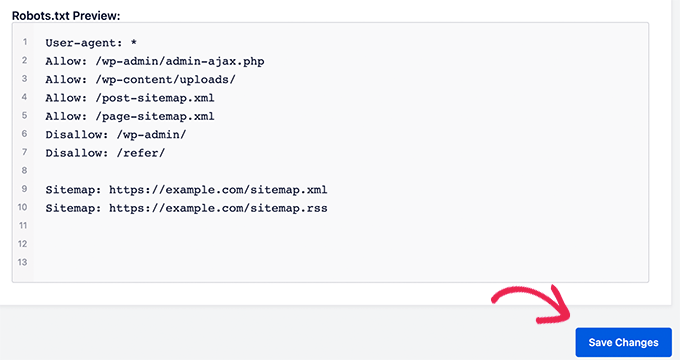

All in One SEO mostrerà il file robots.txt esistente nella sezione “Anteprima robots.txt” nella parte inferiore dello schermo.

Questa versione mostra le regole predefinite aggiunte da WordPress.

Queste regole predefinite indicano ai motori di ricerca di non effettuare il crawling dei file principali di WordPress, consentono ai bot di indicizzare tutti i contenuti e forniscono loro un link alle sitemap XML del sito.

Ora è possibile aggiungere regole personalizzate per migliorare il robots.txt per la SEO.

Per aggiungere una regola, inserire un agente utente nel campo “Agente utente”. Utilizzando un *, la regola verrà applicata a tutti gli agenti utente.

Quindi, selezionare se si desidera “Consentire” o “Disconsentire” il crawling dei motori di ricerca.

Quindi, inserire il nome del file o il percorso della directory nel campo “Percorso directory”.

La regola verrà automaticamente applicata al file robots.txt. Per aggiungere un’altra regola, basta fare clic sul pulsante “Aggiungi regola”.

Si consiglia di aggiungere regole fino a creare il formato robots.txt ideale che abbiamo condiviso sopra.

Le regole personalizzate avranno il seguente aspetto.

Una volta terminato, non dimenticate di fare clic sul pulsante “Salva modifiche” per memorizzare le modifiche.

Metodo 2: Modifica del file Robots.txt con WPCode

WPCode è un potente plugin per gli snippet di codice che consente di aggiungere codice personalizzato al proprio sito web in modo semplice e sicuro.

Include anche una comoda funzione che consente di modificare rapidamente il file robots.txt.

Nota: esiste anche un plugin gratuito di WPCode, ma non include la funzione di editor di file.

La prima cosa da fare è installare il plugin WPCode. Per istruzioni passo passo, consultate la nostra guida per principianti su come installare un plugin di WordPress.

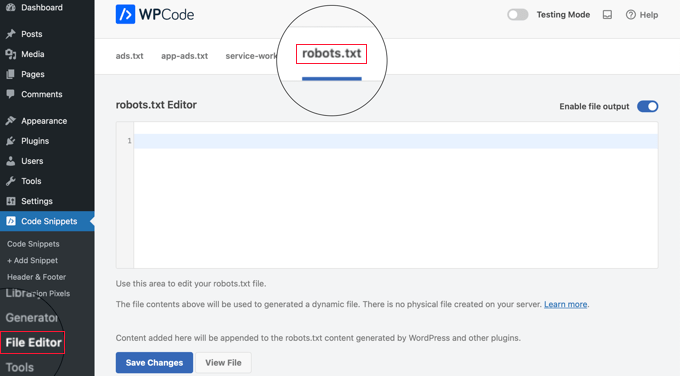

All’attivazione, è necessario navigare nella pagina WPCode ” File Editor. Una volta lì, è sufficiente fare clic sulla scheda ‘robots.txt’ per modificare il file.

Ora è possibile incollare o digitare il contenuto del file robots.txt.

Una volta terminato, assicurarsi di fare clic sul pulsante “Salva modifiche” in fondo alla pagina per memorizzare le impostazioni.

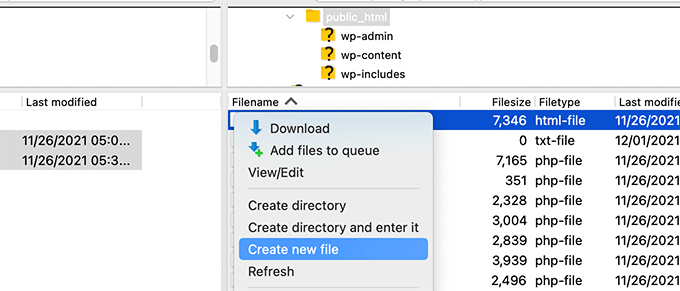

Metodo 3: Modifica manuale del file Robots.txt tramite FTP

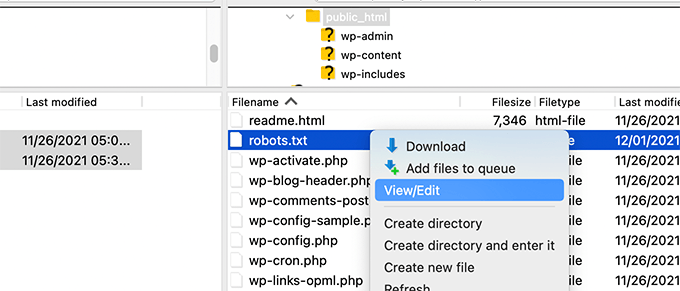

Per questo metodo, è necessario utilizzare un client FTP per modificare il file robots.txt. In alternativa, potete utilizzare il file manager fornito dal vostro hosting WordPress.

È sufficiente collegarsi ai file del proprio sito web WordPress utilizzando un client FTP.

Una volta entrati, sarà possibile vedere il file robots.txt nella cartella principale del sito web.

Se non ne vedete uno, è probabile che non abbiate un file robots.txt.

In questo caso, si può procedere a crearne uno.

Robots.txt è un file di testo semplice, il che significa che è possibile scaricarlo sul computer e modificarlo con qualsiasi editor di testo semplice, come Notepad o TextEdit.

Dopo aver salvato le modifiche, è possibile caricare il file robots.txt nella cartella principale del sito web.

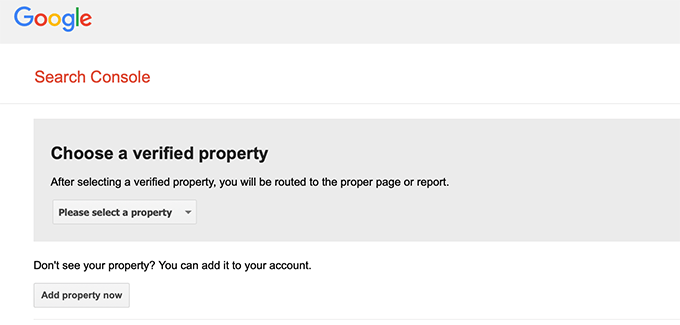

Come testare il file Robots.txt

Una volta creato il file robots.txt, è sempre una buona idea testarlo utilizzando uno strumento robots.txt tester.

Esistono molti strumenti di verifica del robots.txt, ma noi consigliamo di utilizzare quello presente all’interno di Google Search Console.

Per prima cosa, è necessario che il vostro sito sia collegato a Google Search Console. Se non l’avete ancora fatto, consultate la nostra guida su come aggiungere il vostro sito WordPress a Google Search Console.

Quindi, è possibile utilizzare lo strumento di test dei robot di Google Search Console.

È sufficiente selezionare la proprietà dall’elenco a discesa.

Lo strumento recupera automaticamente il file robots.txt del vostro sito web ed evidenzia gli errori e gli avvertimenti se ne trova qualcuno.

Pensieri finali

L’obiettivo dell’ottimizzazione del file robots.txt è quello di impedire ai motori di ricerca di scansionare le pagine che non sono disponibili pubblicamente. Ad esempio, le pagine della cartella wp-plugins o quelle della cartella di amministrazione di WordPress.

Un mito comune tra gli esperti SEO è che il blocco delle categorie, dei tag e delle pagine di archivio di WordPress migliori la velocità di crawl e porti a un’indicizzazione più rapida e a classifiche più alte.

Questo non è vero. È anche contrario alle linee guida per i webmaster di Google.

Si consiglia di seguire il formato robots.txt di cui sopra per creare un file robots.txt per il proprio sito web.

Guide di esperti sull’uso di Robots.txt in WordPress

Ora che sapete come ottimizzare il vostro file robots.txt, potreste voler vedere altri articoli relativi all’uso di robots.txt in WordPress.

- Glossario: Robots.txt

- Come nascondere una pagina di WordPress da Google

- Come impedire ai motori di ricerca di effettuare il crawling di un sito WordPress

- Come eliminare definitivamente un sito WordPress da internet

- Come nascondere facilmente (noindex) i file PDF in WordPress

- Come correggere l’errore “Googlebot non può accedere ai file CSS e JS” in WordPress

- Come configurare correttamente Tutto-in-uno SEO per WordPress (Guida definitiva)

Speriamo che questo articolo vi abbia aiutato a capire come ottimizzare il file robots.txt di WordPress per la SEO. Potreste anche voler consultare la nostra guida definitiva alla SEO di WordPress e le nostre scelte di esperti sui migliori strumenti SEO per WordPress per far crescere il vostro sito web.

Se questo articolo vi è piaciuto, iscrivetevi al nostro canale YouTube per le esercitazioni video su WordPress. Potete trovarci anche su Twitter e Facebook.

Steve

Thanks for this – how does it work on a WP Multisite thou?

WPBeginner Support

For a multisite, you would need to have a robots.txt file in the root folder of each site.

Admin

Pacifique Ndanyuzwe

My wordpress site is new and my robot.txt by default is

user-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

I want google to crawl and index my content. Is that robot.txt okay?

WPBeginner Support

You can certainly use that if you wanted

Admin

Ritesh Seth

Great Airticle…

I was confused from so many days about Robots.txt file and Disallow links. Have copied the tags for robots file. Hope this will solve the issue of my Site

WPBeginner Support

We hope our article will help as well

Admin

Kurt

The files in the screenshots of your home folder are actually located under the public_html folder under my home folder.

I did not have a /refer folder under my public_html folder.

I did not have post or page xml files anywhere on my WP account.

I did include an entry in the robots.txt file I created to disallow crawling my sandbox site. I’m not sure that’s necessary since I’ve already selected the option in WP telling crawlers not to crawl my sandbox site, but I don’t think it will hurt to have the entry.

WPBeginner Support

Some hosts do rename public_html to home which is why you see it there. You would want to ensure Yoast is active for the XML files to be available. The method in this article is an additional precaution to help with preventing crawling your site

Admin

Ahmed

Great article

WPBeginner Support

Thank you

Admin

ASHOK KUMAR JADON

Hello, such a nice article you solve my problem. So Thank You so much

WPBeginner Support

Glad our article could help

Admin

Elyn Ashton

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php <– This is my robot.txt code but im confuse why my /wp-admin is index? How to no index it?

WPBeginner Support

If it was indexed previously you may need to give time for the search engine’s cache to clear

Admin

Ashish kumar

This website really inspire me to start a blog .Thank you lost of tema.this website each and every article have rich of information and explanation.when i have some problem at first i visit this blog . Thank You

WPBeginner Support

Glad our articles can be helpful

Admin

Anna

I am trying to optimise robots for my website using Yoast. However Tools in Yoast does not have the option for ‘File Editor’.

There are just two options

(i) Import and Export

(ii) Bulk editor

May you please advise how this can be addressed. Could it be that I am on a free edition of Yoast?

WPBeginner Support

The free version of Yoast still has the option, your installation may be disallowing file editing in which case you would likely need to use the FTP method.

Admin

Emmanuel Husseni

I really find this article helpful because I really don’t know much on how robot.txt works but now I do.

pls what I don’t understand is how do I find the best format of robot.txt to use on my site (I mean one that works generally)?

I noticed lots of big blogs I check ranking high on search engine uses different robot.txt format..

I’ll be clad to see a reply from you or just anyone that can help

Editorial Staff

Having a sitemap and allowing the areas that need to be allowed is the most important part. The disallow part will vary based on each site. We shared a sample in our blog post, and that should be good for most WordPress sites.

Admin

WPBeginner Support

Hey Emmanuel,

Please see the section regarding the ideal robots.txt file. It depends on your own requirements. Most bloggers exclude WordPress admin and plugin folders from the crawl.

Admin

Emmanuel Husseni

Thank you so much.

now I understand. I guess I’ll start with the general format for now.

jack

Well written article, I recommend the users to do sitemap before creating and enabling their ROBOTS text it will help your site to crawl faster and indexed easily.

Jack

Connie S Owens

I would like to stop the search engines from indexing my archives during their crawl.

Emmanuel Nonye

Thanks alot this article it was really helpful

Cherisa

I keep getting the error message below on google webmaster. I am basically stuck. A few things that were not clear to me on this tutorial is where do I find my site’s root files, how do you determine if you already have a “robots.txt” and how do you edit it?

WPBeginner Support

Hi Cherisa,

Your site’s root folder is the one that contains folders like wp-admin, wp-includes, wp-content, etc. It also contains files like wp-config.php, wp-cron.php, wp-blogheader.php, etc.

If you cannot see a robots.txt file in this folder, then you don’t have one. You can go a head and create a new one.

Admin

Cherisa

Thank you for your response. I have looked everywhere and can’t seem to locate these root files as you describe. Is there a path directory I can take that leads to this folder. Like it is under Settings, etc?

Devender

I had a decent web traffic to my website. Suddenly dropped to zero in the month of May. Till now I have been facing the issue. Please help me to recover my website.

Haris Aslam

Hello There Thank you For This Information, But I Have A Question

That I Just Create The Sitemap.xml and Robots.txt File, & Its Crawling well. But How Can I Create “Product-Sitemap.xml”

There is all list of product in sitemap.xml file. Do I Have To Create Product-sitemap.xml separately?

and submit to google or bing again ?

Can You please Help me out…

Thank You

Mahadi Hassan

I have a problem on robots.txt file setting. Only one robots.txt is showing for all websites. Please help me to show separate robots.txt file of all websites. I have all separate robots.txt file of all individual website. But only one robots.txt file is showing in browser for all websites.

Debu Majumdar

Please explain why did you include

Disallow: /refer/

in the beginner Robots.txt example? I do not understand the implications of this line. Is this important for the beginner? You have explained the other two Disallowed ones.

Thanks.

WPBeginner Support

Hi Debu,

This example was from WPBeginner’s robots.txt file. At WPBeginner we use ThirstyAffiliates to manage affiliate links and cloak URLs. Those URLs have /refer/ in them, that’s why we block them in our robots.txt file.

Admin

Evaristo

How can I put all tags/mydomain.Com in nofollow? In robots.txt to concentrate the link Juice? Thanks.

harsh kumar

hey,,i am getting error in yoast seo regarding site map..once i click on fix it ,,,it’s coming again..my site html is not loading properly

Tom

I’ve just been reviewing my Google Webmaster Tools account and using the Search Console, I’ve found the following:

Page partially loaded

Not all page resources could be loaded. This can affect how Google sees and understands your page. Fix availability problems for any resources that can affect how Google understands your page.

This is because all CSS stylesheets associated with Plugins are disallowed by the default robots.txt.

I understand good reasons why I shouldn’t just make this allowable, but what would be an alternative as I would suspect the Google algorithms are marking down the site for not seeing these.

Suren

Hi,

Whenever, I search my site on the google this text appears below the link: “A description for this result is not available because of this site’s robots.txt”

How, can i solve this issue?

Regards

WPBeginner Support

Hi Suren,

Seems like someone accidentally changed your site’s privacy settings. Go to Settings » Reading page and scroll down to ‘Search engine visibility’ section. Make sure that the box next to is unchecked.

Admin

Divyesh

Hello

As i seen in webmaster tool, i got robot.txt file like below :

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

let me know is that okey ? or should i use any other ?

John Cester

I want to know, does it a good idea to block (disallow) “/wp-content/plugins/” in robots.tx? Every time i remove a plugin it shows 404 error in some pages of that plugin.

Himanshu singh

I loved this explanation. As a beginner I was very confused about robot.txt file and its uses. But now I know what is its purpose.

rahul

in some robot.txt file index.php has been disallowed. Can you explain why ? is it a good practice.

Waleed Barakat

Thanks for passing by this precious info.

Awais Ahmed

Can you please tell me why this happening on webmaster tool:

Network unreachable: robots.txt unreachableWe were unable to crawl your Sitemap because we found a robots.txt file at the root of your site but were unable to download it. Please ensure that it is accessible or remove it completely.

robots.txt file exist but still

Dozza

Interesting update from the Yoast team on this at

Quote: “The old best practices of having a robots.txt that blocks access to your wp-includes directory and your plugins directory are no longer valid.”

natveimaging

Allow: /wp-content/uploads/

Shouldn’t this be?

Disallow: /wp-content/uploads/

Because you are aware that google will index all your uploads pages as public URLs right? And then you will get slapped with errors for the page itself. Is there something I am missing here?

nativeimaging

Overall, its the actual pages that google crawls to generate image maps, NOT the uploads folders. Then you would have a problem of all the smaller image sizes, and other images that are for UI will also get indexed.

This seems to be the best option:

Disallow: /wp-content/uploads/

If i’m incorrect, please explain this to me so I can understand your angle here.

Jason

My blog url not indexing do i need to change my robots.txt?

Im using this robots.txt

iyan

how to create robot txt which is ONLY allow index for page and Post.. thanks

Simaran Singh

I am not sure what’s the problem but my robots.txt has two versions.

One at http://www.example.com/robots.txt and second at example.com/robots.txt

Anybody, please help! Let me know what can be the possible cause and how to correct it?

WPBeginner Support

Most likely, your web host allows your site to be accessed with both www and non-www urls. Try changing robots.txt using an FTP client. Then examine it from both URLs if you can see your changes on both URLs then this means its the same file.

Admin

Simaran Singh

Thanks for the quick reply. I have already done that, but I am not able to see any change. Is there any other way to resolve it?

Martin conde

Yoasts blogpost about this topic was right above yours in my search so of course I checked them both. They are contradicting each other a little bit.. For example yoast said that disallowing plugin directories and others, might hinder the Google crawlers when fetching your site since plugins may output css or js. Also mentioned (and from my own experience), yoast doesn’t add anything sitemap related to the robots.txt, rather generates it so that you can add it to your search console. Here is the link to his post, maybe you can re-check because it is very hard to choose whose word to take for it

MM Nauman

As I’m Not Good in Creating this Robotstxt file So Can I use your Robots.txt file by changing the parameters like url and sitemap of my site is it good? or should I create a different one

Mohit Chauhan

Hi,

Today i got this mail from Google “Googlebot cannot access CSS and JS files”…what can be the solution?

Thanks

Parmod

Let me guess… You are using CDN services to import CSS and JS files.

or

It may be possible that you have written wrong syntax in these file.

Rahul

I have a question about adding Sitemaps. How can I add Yahoo and Bing Sitemap to Robots file and WordPress Directory?

Gerbrand Petersen

Thanks for the elaborate outline of using the robots file. Does anyone know if Yahoo is using this robots.txt too, and does it obey the rules mentioned in the file? I ask this since I have a “Disallow” for a certain page in my file, but I do receive traffic coming from Yahoo on that page. Nothing from Google, as it should be. Thanks in advance.

Erwin

correction…

“If you are using Yoast’s WordPress SEO plugin or some other plugin to generate your XML sitemap, then your plugin will try to automatically add your sitemap related lines into robots.txt file.”

Not true. WordPress SEO doesn’t add the sitemap to the robots.txt

“I’ve always felt linking to your XML sitemap from your robots.txt is a bit nonsense. You should be adding them manually to your Google and Bing Webmaster Tools and make sure you look at their feedback about your XML sitemap. This is the reason our WordPress SEO plugin doesn’t add it to your robots.txt.”

https://yoast.com/wordpress-robots-txt-example/

Also more recommended is not to disallow the wp-plugins directory (reasons see Yoast’s post)

And personally I like to simply remover the readme.txt file…

hyma

I understood it robots.txt file and use of robots file. What is the site map how do I create sitemap for my site.

Rick R. Duncan

After reading Google’s documentation I’m under the impression that the directive to use in the robots.txt file is disallow which only tells the bots what they can and cannot crawl. It does not tell them what can and cannot be indexed. You need to use the noindex robots meta tag to have a page noindexed.

Nitin

really good article for seo optimized robots.txt file. But I need you to give a tutorial on how to upload robots.txt file to server. As, being a beginner it seems to be a drastic problem to upload that file.

By the way thanks to share such beneficial information.

-Nitin

Parmod

Upload it to your server/public_hmtl/(Your-site-name) … in this folder

Jenny

What is the best way to add code to HTTacess to block multiple spam bot refers for their url and Ip address if no URL is given

I know if you get wrong syntax when doing httacess it can take your site off line I am a newbie and need to block these annoying multiple urls from Russia, China, Ukraine etc.

Many thanks

Hazel Andrews

Thanks for those tips….robot txt files now amended! yay!

Rahat

why have to add Allow: !!!

if I mention only which have to Disallow that enough. Don’t have to write code for Allow because Googlebot or Bingbot will crawl all other thing automatically.

So why should I use Allow again?

Connor Rickett

Since lacking the Robots.txt file doesn’t stop the site from being crawled, I find myself curious: Is there any sort of hard data on exactly how much having the file will improve SEO performance?

I did a quick Google search, and didn’t see any sort of quantitative data on it. It’s about half a million articles saying, “Hey, this makes SEO better!” but I’d really like to know what we’re talking about here, even generally.

Is this a 5% boost? 50? 500?

WPBeginner Support

Search engines don’t share such data. While not having a robots.txt file does not stop search engines from crawling or indexing a website. However, it is a recommended best practice.

Admin

Connor Rickett

Thanks for taking the time to get back to me, I appreciate it!

JD Myers

Good timing on this. I was trying to find this information just yesterday.

The reason I was searching for it is that Google Webmaster tools was telling me that they could not properly crawl my site because I was blocking various resources needed for the proper rendering of the page.

These resources included those found in /wp-content/plugins/

After I allowed this folder, the warning disappeared.

Any thoughts on this?

WPBeginner Support

You can safely ignore those warnings. It is only a warning if you actually had content there that you would want to get indexed. Sometimes users have restricted search bots and have forgotten about it. These warnings come in handy in those situations.

Admin

Chetan jadhav

I have a question that many people out there use static sitemap, and you know what they have wordpress site. Should we us static or sitemap genrated by worpress.

Wilton Calderon

NIce, i like the way Wpbeginner have, and with that rank in alexa, look to me is one of the best way to sue robots.txt..

Brigitte Burke

what does my robots.txt file mean if it looks like this?

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /xmlrpc.php

Editorial Staff

It’s just saying that search engines should not index your wp-admin folder, wp-includes folder, and the xml-rpc file. Sometimes disallowing /wp-includes/ can block certain scripts for search engines specially if your site is using those scripts. This can hurt your SEO.

The best thing to do is go to Google Webmaster Tools and fetch your website as a bot there. If everything loads fine, then you have nothing to worry about. If it says that scripts are blocked, then you may want to take out the wp-includes line.

Admin

hercules

I see no logic in your idea about having a script within the includes directory that can be used by a crawn / robot .. and another, if there is an isolated case, it is better after specify the default wordpress allow this file you imagine that search engines use his scripts! after all, wordpress has certainly not by default an robots.txt anti serch engines!!!!